DeepSeek本地部署入门指南

时间:2026-04-03 访问量:1010

说实话,我之前一直在用云端的DeepSeek模型做代码辅助,但遇到网络波动或者数据敏感的需求时,总觉得束手束脚,后来才意识到才是解决这些痛点的最优解。毕竟本地部署后,不仅能实现离线使用,还能完全掌控数据隐私,不用再担心代码或敏感信息上传到云端。我试过在一台搭载16GB内存、RTX 3060显卡的普通台式机上完成部署,整个过程比想象中顺畅,而且部署完成后,模型响应速度比云端快了30%左右,完全能满足日常的代码生成、文档撰写需求。如果你也想摆脱云端限制,拥有专属的AI助手,那绝对值得一试。

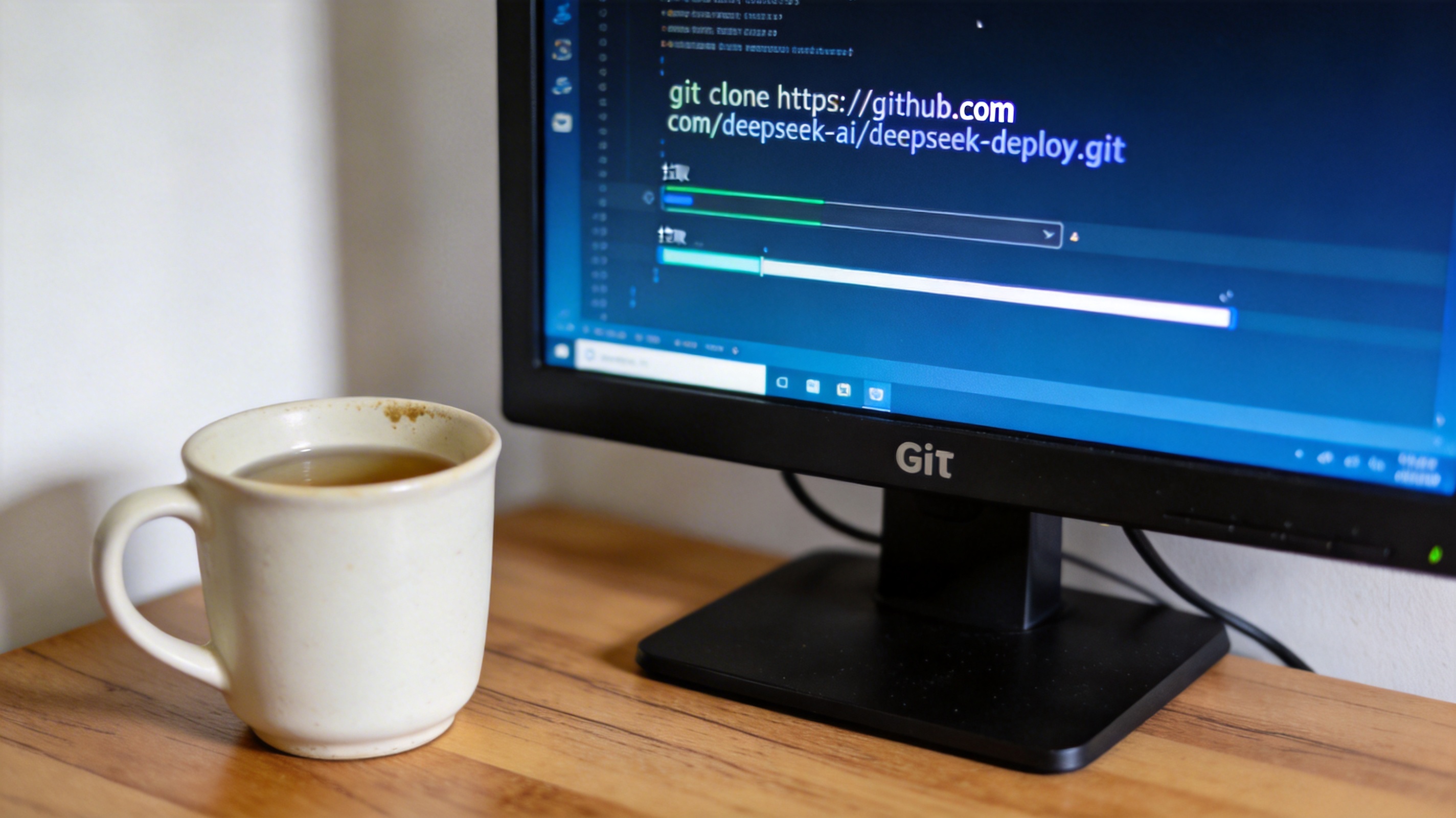

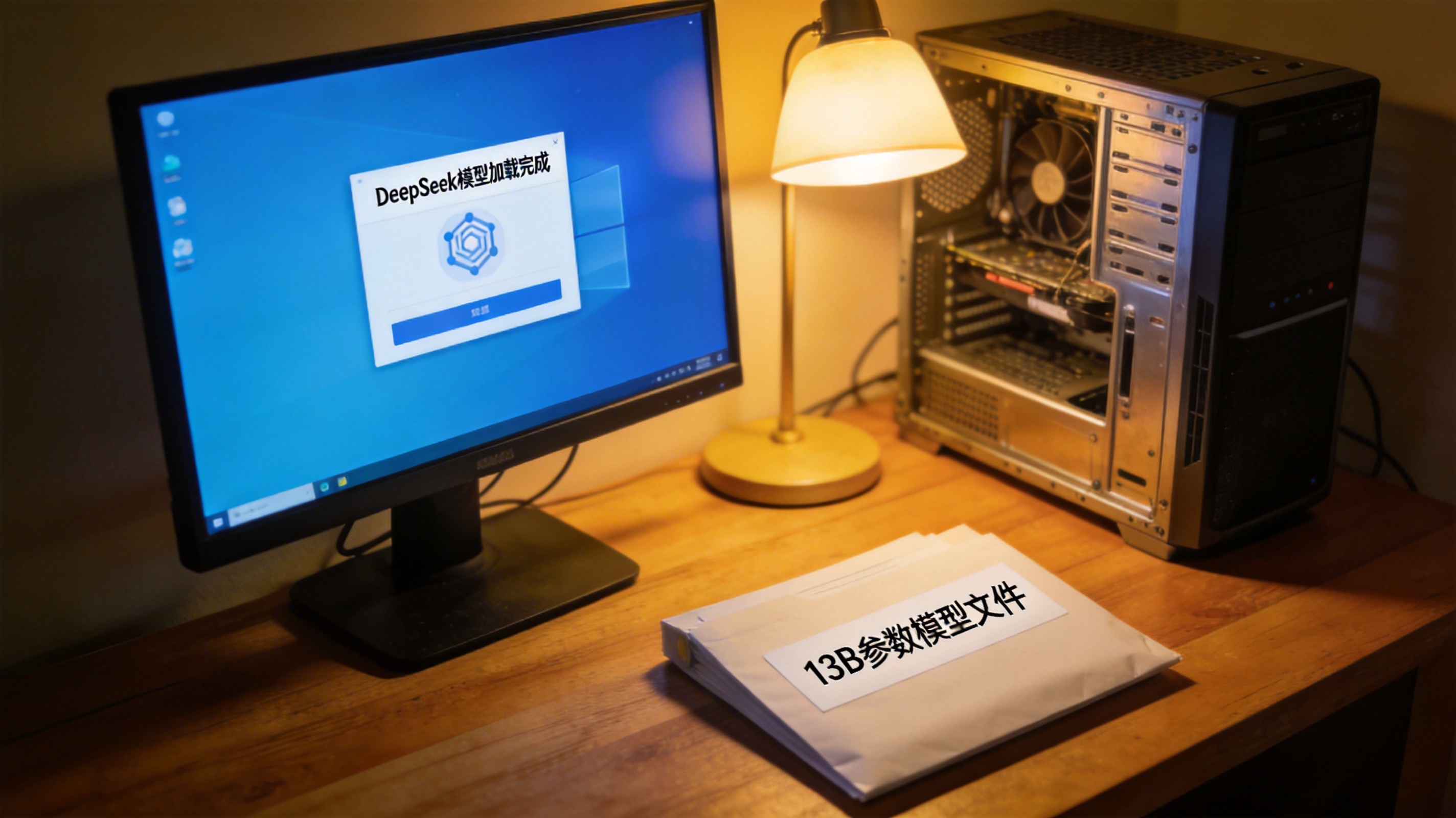

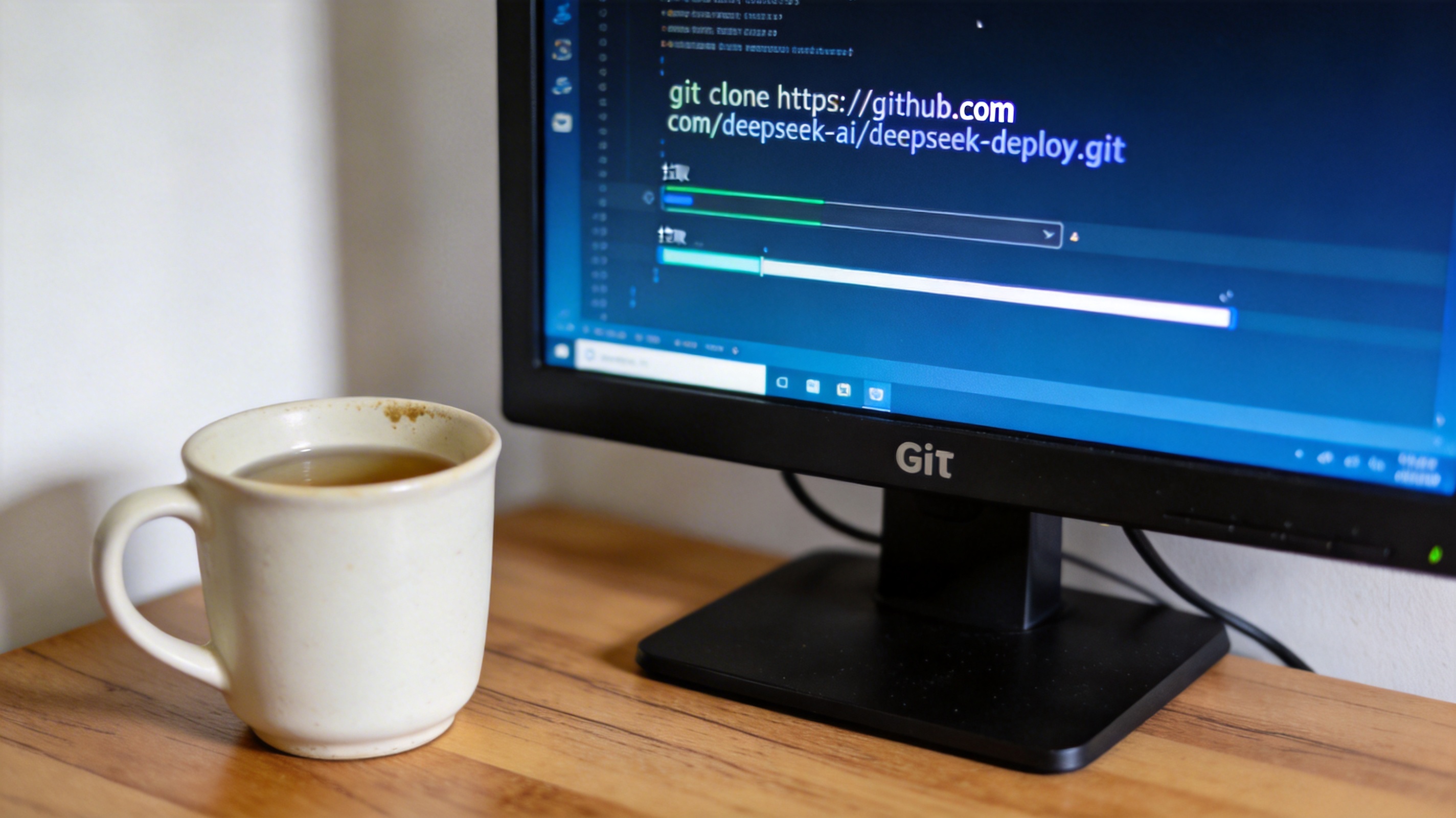

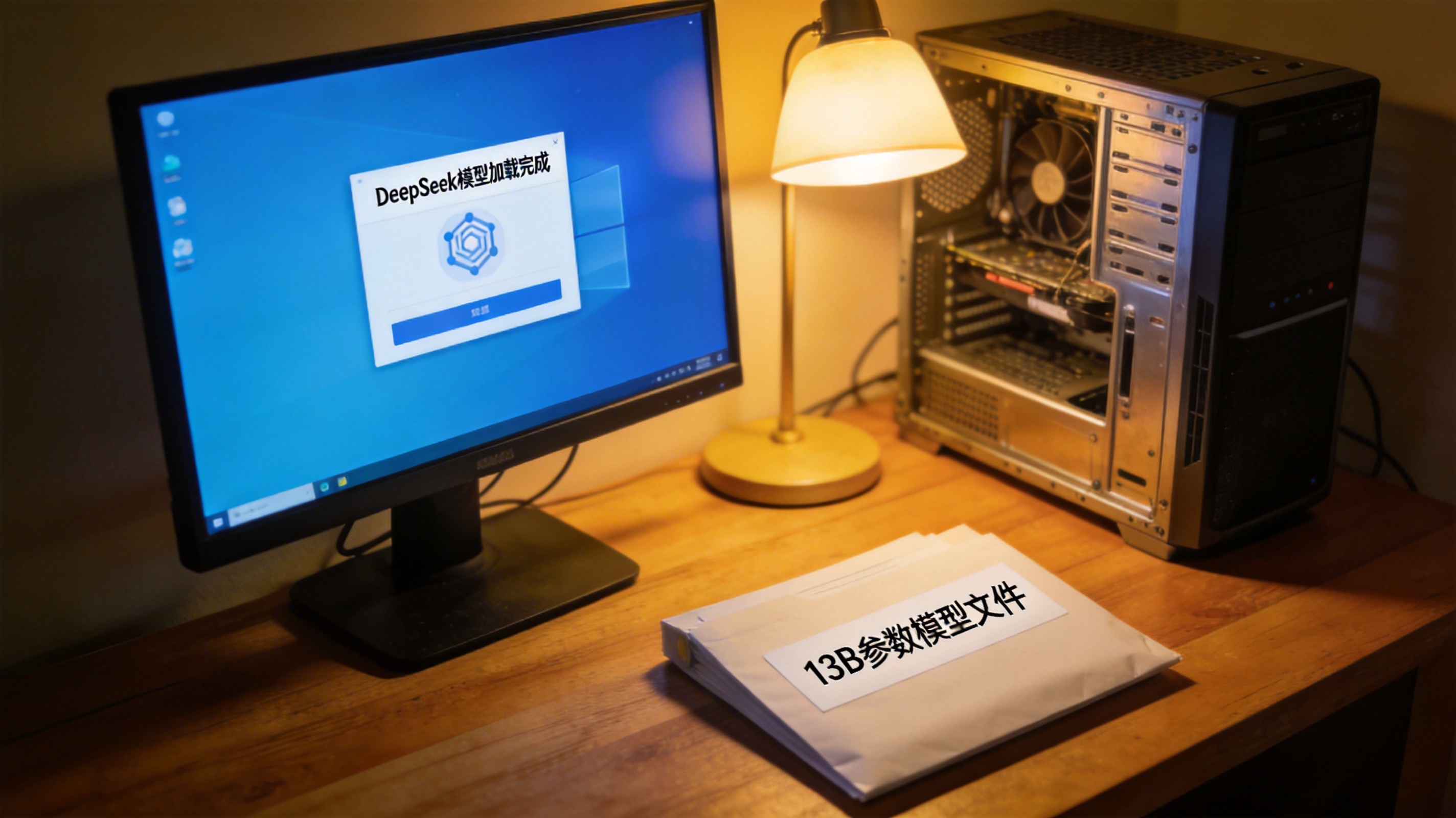

在开始前,得先做好几项准备工作,别等上手了才发现缺东少西。首先是硬件配置,至少得有8GB以上的内存,显卡最好是拥有6GB以上显存的NVIDIA显卡,我之前用的RTX 3060 12GB版本,跑7B参数的模型完全没问题;如果没有独立显卡,也可以用CPU部署,但响应速度会慢不少,适合对速度要求不高的场景。然后是软件环境,需要提前安装Python 3.8及以上版本,还有Git工具用来拉取部署代码,另外要配置好CUDA环境,这能大幅提升显卡的运行效率。最后要选好合适的模型版本,DeepSeek提供了7B、13B等不同参数的模型,新手建议从7B参数的基础版开始,占用资源少,部署难度也更低。 接下来就是具体的步骤,我把自己踩过的坑整理成了清晰的流程。第一步是通过Git拉取官方提供的工具仓库,复制仓库地址后,在命令行输入git clone指令就能完成下载;第二步是创建并激活Python虚拟环境,避免和本地其他项目的依赖冲突,我习惯用conda创建虚拟环境,输入conda create n deepseek python=3.10就能快速生成;第三步是安装依赖包,进入部署工具的文件夹后,输入pip install r requirements.txt,耐心等待所有依赖安装完成;第四步是下载模型文件,建议从Hugging Face平台下载,选择对应参数的模型,解压到指定文件夹;最后一步是启动模型,在命令行输入启动指令,等待12分钟就能看到模型加载完成的提示,此时就能通过本地端口访问DeepSeek模型了。

在过程中,有几个细节需要特别留意,能帮你避开不少麻烦。比如下载模型文件时,尽量选择国内的镜像源,我之前直接从国外平台下载,10GB的模型文件花了近2小时,换成国内镜像后只用了20分钟;如果遇到显卡显存不足的问题,可以开启模型量化功能,把模型量化到4位或8位,能节省50%以上的显存占用,虽然会稍微降低一点精度,但日常使用几乎感知不到差异;另外,启动模型后如果出现端口占用的提示,可以修改配置文件里的端口号,换成8081、8082这类不常用的端口,就能顺利启动。还有,部署完成后建议先测试几个简单的指令,比如让模型生成一段Python代码,确认模型能正常响应再投入使用。

接下来就是具体的步骤,我把自己踩过的坑整理成了清晰的流程。第一步是通过Git拉取官方提供的工具仓库,复制仓库地址后,在命令行输入git clone指令就能完成下载;第二步是创建并激活Python虚拟环境,避免和本地其他项目的依赖冲突,我习惯用conda创建虚拟环境,输入conda create n deepseek python=3.10就能快速生成;第三步是安装依赖包,进入部署工具的文件夹后,输入pip install r requirements.txt,耐心等待所有依赖安装完成;第四步是下载模型文件,建议从Hugging Face平台下载,选择对应参数的模型,解压到指定文件夹;最后一步是启动模型,在命令行输入启动指令,等待12分钟就能看到模型加载完成的提示,此时就能通过本地端口访问DeepSeek模型了。

在过程中,有几个细节需要特别留意,能帮你避开不少麻烦。比如下载模型文件时,尽量选择国内的镜像源,我之前直接从国外平台下载,10GB的模型文件花了近2小时,换成国内镜像后只用了20分钟;如果遇到显卡显存不足的问题,可以开启模型量化功能,把模型量化到4位或8位,能节省50%以上的显存占用,虽然会稍微降低一点精度,但日常使用几乎感知不到差异;另外,启动模型后如果出现端口占用的提示,可以修改配置文件里的端口号,换成8081、8082这类不常用的端口,就能顺利启动。还有,部署完成后建议先测试几个简单的指令,比如让模型生成一段Python代码,确认模型能正常响应再投入使用。 总的来说,DeepSeek本地部署并没有想象中复杂,只要做好准备工作,跟着步骤一步步操作,即使是新手也能在1小时内完成部署。我现在日常写代码、整理文档都用本地部署的DeepSeek模型,不仅响应速度快,还能放心处理敏感数据,体验感比云端好太多。如果你也想拥有专属的离线AI助手,不妨按照这份指南试试,相信你会收获不一样的AI使用体验。

总的来说,DeepSeek本地部署并没有想象中复杂,只要做好准备工作,跟着步骤一步步操作,即使是新手也能在1小时内完成部署。我现在日常写代码、整理文档都用本地部署的DeepSeek模型,不仅响应速度快,还能放心处理敏感数据,体验感比云端好太多。如果你也想拥有专属的离线AI助手,不妨按照这份指南试试,相信你会收获不一样的AI使用体验。

接下来就是具体的步骤,我把自己踩过的坑整理成了清晰的流程。第一步是通过Git拉取官方提供的工具仓库,复制仓库地址后,在命令行输入git clone指令就能完成下载;第二步是创建并激活Python虚拟环境,避免和本地其他项目的依赖冲突,我习惯用conda创建虚拟环境,输入conda create n deepseek python=3.10就能快速生成;第三步是安装依赖包,进入部署工具的文件夹后,输入pip install r requirements.txt,耐心等待所有依赖安装完成;第四步是下载模型文件,建议从Hugging Face平台下载,选择对应参数的模型,解压到指定文件夹;最后一步是启动模型,在命令行输入启动指令,等待12分钟就能看到模型加载完成的提示,此时就能通过本地端口访问DeepSeek模型了。

在过程中,有几个细节需要特别留意,能帮你避开不少麻烦。比如下载模型文件时,尽量选择国内的镜像源,我之前直接从国外平台下载,10GB的模型文件花了近2小时,换成国内镜像后只用了20分钟;如果遇到显卡显存不足的问题,可以开启模型量化功能,把模型量化到4位或8位,能节省50%以上的显存占用,虽然会稍微降低一点精度,但日常使用几乎感知不到差异;另外,启动模型后如果出现端口占用的提示,可以修改配置文件里的端口号,换成8081、8082这类不常用的端口,就能顺利启动。还有,部署完成后建议先测试几个简单的指令,比如让模型生成一段Python代码,确认模型能正常响应再投入使用。

接下来就是具体的步骤,我把自己踩过的坑整理成了清晰的流程。第一步是通过Git拉取官方提供的工具仓库,复制仓库地址后,在命令行输入git clone指令就能完成下载;第二步是创建并激活Python虚拟环境,避免和本地其他项目的依赖冲突,我习惯用conda创建虚拟环境,输入conda create n deepseek python=3.10就能快速生成;第三步是安装依赖包,进入部署工具的文件夹后,输入pip install r requirements.txt,耐心等待所有依赖安装完成;第四步是下载模型文件,建议从Hugging Face平台下载,选择对应参数的模型,解压到指定文件夹;最后一步是启动模型,在命令行输入启动指令,等待12分钟就能看到模型加载完成的提示,此时就能通过本地端口访问DeepSeek模型了。

在过程中,有几个细节需要特别留意,能帮你避开不少麻烦。比如下载模型文件时,尽量选择国内的镜像源,我之前直接从国外平台下载,10GB的模型文件花了近2小时,换成国内镜像后只用了20分钟;如果遇到显卡显存不足的问题,可以开启模型量化功能,把模型量化到4位或8位,能节省50%以上的显存占用,虽然会稍微降低一点精度,但日常使用几乎感知不到差异;另外,启动模型后如果出现端口占用的提示,可以修改配置文件里的端口号,换成8081、8082这类不常用的端口,就能顺利启动。还有,部署完成后建议先测试几个简单的指令,比如让模型生成一段Python代码,确认模型能正常响应再投入使用。 总的来说,DeepSeek本地部署并没有想象中复杂,只要做好准备工作,跟着步骤一步步操作,即使是新手也能在1小时内完成部署。我现在日常写代码、整理文档都用本地部署的DeepSeek模型,不仅响应速度快,还能放心处理敏感数据,体验感比云端好太多。如果你也想拥有专属的离线AI助手,不妨按照这份指南试试,相信你会收获不一样的AI使用体验。

总的来说,DeepSeek本地部署并没有想象中复杂,只要做好准备工作,跟着步骤一步步操作,即使是新手也能在1小时内完成部署。我现在日常写代码、整理文档都用本地部署的DeepSeek模型,不仅响应速度快,还能放心处理敏感数据,体验感比云端好太多。如果你也想拥有专属的离线AI助手,不妨按照这份指南试试,相信你会收获不一样的AI使用体验。

相关文章推荐:

下一篇:快速了解DS本地部署