本地私有化部署 AI 提升数据安全快速上手

时间:2026-04-06 访问量:1007

说实话,我之前帮一家做医疗数据处理的客户做技术方案时,深刻感受到企业对AI数据安全的焦虑——他们用公有云AI工具处理患者病历,总担心核心数据泄露,甚至遇到过第三方平台数据调用日志泄露的风险。这时候就成了刚需,毕竟把AI模型和核心数据都放在企业自己的服务器里,完全脱离公网环境,数据的访问、处理、存储全由自己掌控,能从根源上避免公有云环境下的数据泄露、合规风险。就像这家医疗客户,之前每月要花3万多在公有云AI服务上,换成本地私有化部署后,不仅数据安全等级拉满,长期来看还能节省近40%的成本。

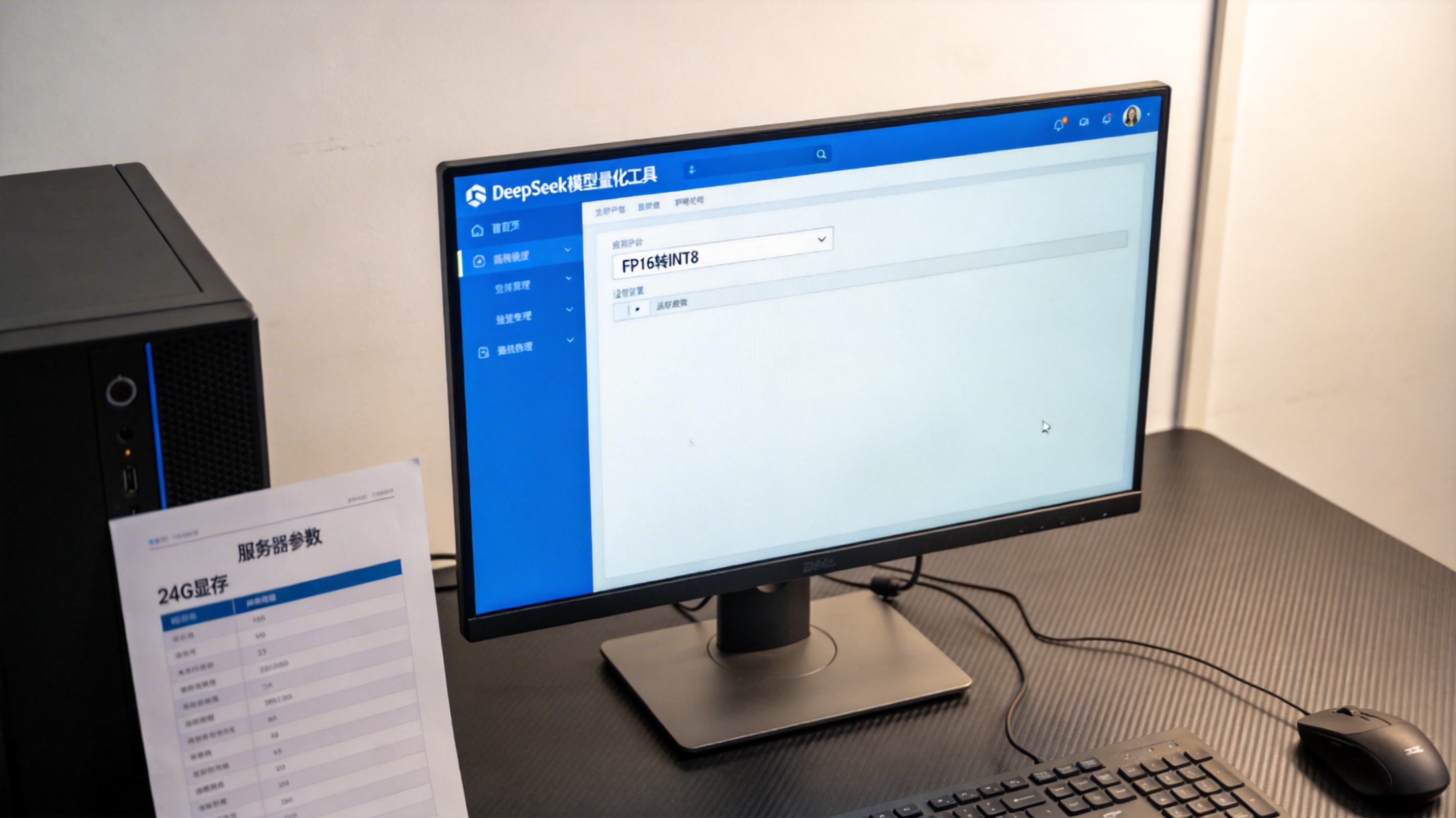

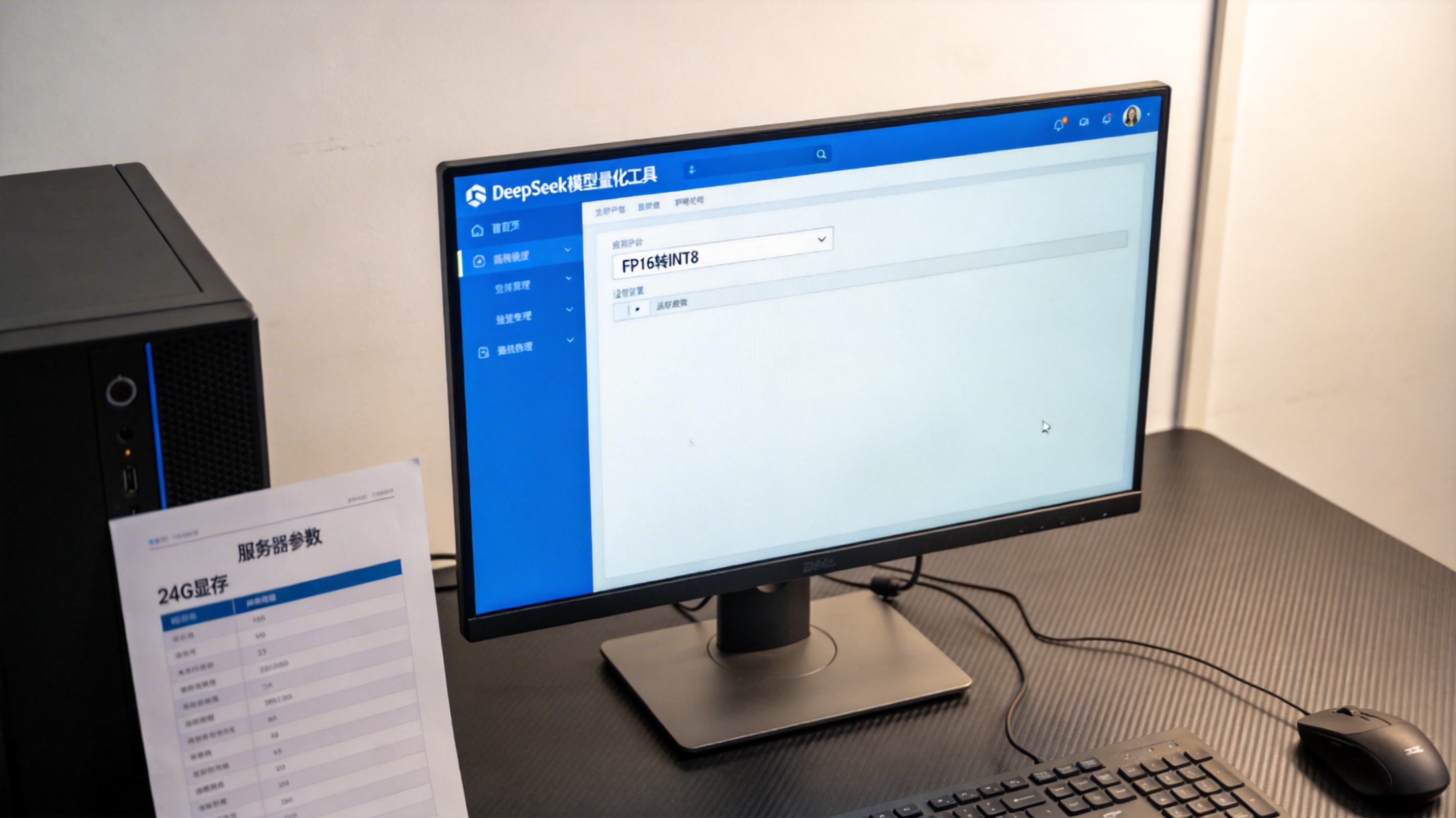

说到,准备做本地私有化部署前,得先理清几个核心条件:首先是硬件配置,我试过用一台搭载16核CPU、64G内存、24G显存的服务器,就能流畅运行大部分轻量级AI模型;如果是处理大语言模型,比如DeepSeek本地私有化部署方案,建议配双32G显存的GPU,能把推理速度提升3倍以上。其次是系统环境,优先选Ubuntu 22.04或者CentOS 8,这两个系统对AI框架的兼容性最好,还要提前装好Docker和NVIDIA Container Toolkit,方便快速部署容器化的AI模型。另外,得提前梳理企业的核心数据类型,比如是文本、图像还是结构化数据,这样能更精准地选择适配的本地私有化部署方案。 具体做本地私有化部署 AI 提升数据安全的步骤其实没那么复杂:第一步是选对方案,比如DeepSeek本地私有化部署方案,它提供了预打包的容器镜像,能把部署时间从3天压缩到4小时内;第二步是硬件调试,先测试服务器的GPU利用率,确保空载时显存占用不超过10%,再用测试数据跑通模型推理流程,验证数据处理的准确性;第三步是搭建内网隔离环境,用企业现有的防火墙把AI服务器划分到独立的VLAN,只允许指定IP地址访问,同时开启数据加密存储,所有输入输出数据都用AES256加密;最后是部署监控工具,实时监测AI模型的运行状态和数据访问日志,一旦发现异常访问就自动触发告警。

说到本地私有化部署 AI 提升数据安全,做本地私有化部署时,有几个坑我之前踩过,得提前注意:首先是模型适配问题,有些开源AI模型没有针对本地环境优化,可能出现推理速度慢、内存溢出的情况,这时候可以用模型量化工具把FP16精度的模型转成INT8,能节省近50%的显存占用;其次是合规性问题,比如处理金融、医疗数据的企业,要确保本地私有化部署的AI方案符合数据安全法和行业监管要求,比如数据留存时间、访问权限分级等;还有就是维护成本,本地服务器需要专人定期更新系统补丁、优化模型性能,建议每月做一次全量数据备份,避免硬件故障导致数据丢失。

具体做本地私有化部署 AI 提升数据安全的步骤其实没那么复杂:第一步是选对方案,比如DeepSeek本地私有化部署方案,它提供了预打包的容器镜像,能把部署时间从3天压缩到4小时内;第二步是硬件调试,先测试服务器的GPU利用率,确保空载时显存占用不超过10%,再用测试数据跑通模型推理流程,验证数据处理的准确性;第三步是搭建内网隔离环境,用企业现有的防火墙把AI服务器划分到独立的VLAN,只允许指定IP地址访问,同时开启数据加密存储,所有输入输出数据都用AES256加密;最后是部署监控工具,实时监测AI模型的运行状态和数据访问日志,一旦发现异常访问就自动触发告警。

说到本地私有化部署 AI 提升数据安全,做本地私有化部署时,有几个坑我之前踩过,得提前注意:首先是模型适配问题,有些开源AI模型没有针对本地环境优化,可能出现推理速度慢、内存溢出的情况,这时候可以用模型量化工具把FP16精度的模型转成INT8,能节省近50%的显存占用;其次是合规性问题,比如处理金融、医疗数据的企业,要确保本地私有化部署的AI方案符合数据安全法和行业监管要求,比如数据留存时间、访问权限分级等;还有就是维护成本,本地服务器需要专人定期更新系统补丁、优化模型性能,建议每月做一次全量数据备份,避免硬件故障导致数据丢失。 总的来说,本地私有化部署 AI 提升数据安全是企业数字化转型中保障核心资产的关键选择,尤其是对数据敏感型行业来说,它能在不牺牲AI能力的前提下,把数据安全牢牢握在自己手里。如果企业刚开始接触本地私有化部署,不妨从DeepSeek本地私有化部署方案入手,它的文档和技术支持都很完善,能降低初期的部署门槛。另外,建议先从小规模的测试环境开始验证,跑通核心业务流程后再逐步扩大部署范围,这样能最大程度降低试错成本,让AI能力真正为企业赋能的同时,筑牢数据安全的防线。

总的来说,本地私有化部署 AI 提升数据安全是企业数字化转型中保障核心资产的关键选择,尤其是对数据敏感型行业来说,它能在不牺牲AI能力的前提下,把数据安全牢牢握在自己手里。如果企业刚开始接触本地私有化部署,不妨从DeepSeek本地私有化部署方案入手,它的文档和技术支持都很完善,能降低初期的部署门槛。另外,建议先从小规模的测试环境开始验证,跑通核心业务流程后再逐步扩大部署范围,这样能最大程度降低试错成本,让AI能力真正为企业赋能的同时,筑牢数据安全的防线。

具体做本地私有化部署 AI 提升数据安全的步骤其实没那么复杂:第一步是选对方案,比如DeepSeek本地私有化部署方案,它提供了预打包的容器镜像,能把部署时间从3天压缩到4小时内;第二步是硬件调试,先测试服务器的GPU利用率,确保空载时显存占用不超过10%,再用测试数据跑通模型推理流程,验证数据处理的准确性;第三步是搭建内网隔离环境,用企业现有的防火墙把AI服务器划分到独立的VLAN,只允许指定IP地址访问,同时开启数据加密存储,所有输入输出数据都用AES256加密;最后是部署监控工具,实时监测AI模型的运行状态和数据访问日志,一旦发现异常访问就自动触发告警。

说到本地私有化部署 AI 提升数据安全,做本地私有化部署时,有几个坑我之前踩过,得提前注意:首先是模型适配问题,有些开源AI模型没有针对本地环境优化,可能出现推理速度慢、内存溢出的情况,这时候可以用模型量化工具把FP16精度的模型转成INT8,能节省近50%的显存占用;其次是合规性问题,比如处理金融、医疗数据的企业,要确保本地私有化部署的AI方案符合数据安全法和行业监管要求,比如数据留存时间、访问权限分级等;还有就是维护成本,本地服务器需要专人定期更新系统补丁、优化模型性能,建议每月做一次全量数据备份,避免硬件故障导致数据丢失。

具体做本地私有化部署 AI 提升数据安全的步骤其实没那么复杂:第一步是选对方案,比如DeepSeek本地私有化部署方案,它提供了预打包的容器镜像,能把部署时间从3天压缩到4小时内;第二步是硬件调试,先测试服务器的GPU利用率,确保空载时显存占用不超过10%,再用测试数据跑通模型推理流程,验证数据处理的准确性;第三步是搭建内网隔离环境,用企业现有的防火墙把AI服务器划分到独立的VLAN,只允许指定IP地址访问,同时开启数据加密存储,所有输入输出数据都用AES256加密;最后是部署监控工具,实时监测AI模型的运行状态和数据访问日志,一旦发现异常访问就自动触发告警。

说到本地私有化部署 AI 提升数据安全,做本地私有化部署时,有几个坑我之前踩过,得提前注意:首先是模型适配问题,有些开源AI模型没有针对本地环境优化,可能出现推理速度慢、内存溢出的情况,这时候可以用模型量化工具把FP16精度的模型转成INT8,能节省近50%的显存占用;其次是合规性问题,比如处理金融、医疗数据的企业,要确保本地私有化部署的AI方案符合数据安全法和行业监管要求,比如数据留存时间、访问权限分级等;还有就是维护成本,本地服务器需要专人定期更新系统补丁、优化模型性能,建议每月做一次全量数据备份,避免硬件故障导致数据丢失。 总的来说,本地私有化部署 AI 提升数据安全是企业数字化转型中保障核心资产的关键选择,尤其是对数据敏感型行业来说,它能在不牺牲AI能力的前提下,把数据安全牢牢握在自己手里。如果企业刚开始接触本地私有化部署,不妨从DeepSeek本地私有化部署方案入手,它的文档和技术支持都很完善,能降低初期的部署门槛。另外,建议先从小规模的测试环境开始验证,跑通核心业务流程后再逐步扩大部署范围,这样能最大程度降低试错成本,让AI能力真正为企业赋能的同时,筑牢数据安全的防线。

总的来说,本地私有化部署 AI 提升数据安全是企业数字化转型中保障核心资产的关键选择,尤其是对数据敏感型行业来说,它能在不牺牲AI能力的前提下,把数据安全牢牢握在自己手里。如果企业刚开始接触本地私有化部署,不妨从DeepSeek本地私有化部署方案入手,它的文档和技术支持都很完善,能降低初期的部署门槛。另外,建议先从小规模的测试环境开始验证,跑通核心业务流程后再逐步扩大部署范围,这样能最大程度降低试错成本,让AI能力真正为企业赋能的同时,筑牢数据安全的防线。

相关文章推荐: