AI 智能对话模型本地部署方法教程

时间:2026-02-08 访问量:1020

随着AI智能对话模型的普及,很多人像我之前一样,既想享受AI对话的便捷,又担心云端数据隐私泄露,还怕网络卡顿影响体验,这时候AI 智能对话模型本地部署方法就成了刚需。我试过把开源的Llama 27B模型部署在自己的台式机上,不仅能离线和AI聊工作方案、写脚本,还能完全掌控数据,不用怕敏感信息上传云端,这种私有性和稳定性是云端服务比不了的,也让我越来越重视AI 本地化部署私有服务器搭建这类技术。

想要搞定AI 智能对话模型本地部署方法,前期准备工作得做足,我之前踩过不少坑。首先得确认硬件配置,至少要有16GB以上内存,显卡最好是8GB显存的NVIDIA RTX系列,我用的RTX 3060 12GB显存,跑7B参数的模型刚好够用;然后要选合适的开源模型,比如Llama 2、Qwen7B都是不错的轻量型选择,还得准备好部署工具,比如Ollama或者Text Generation WebUI,这两款工具我都试过,Ollama操作更简单,适合新手,Text Generation WebUI功能更全,适合有一定基础的用户,这些都是AI 本地部署完整教程与工具里的核心内容。

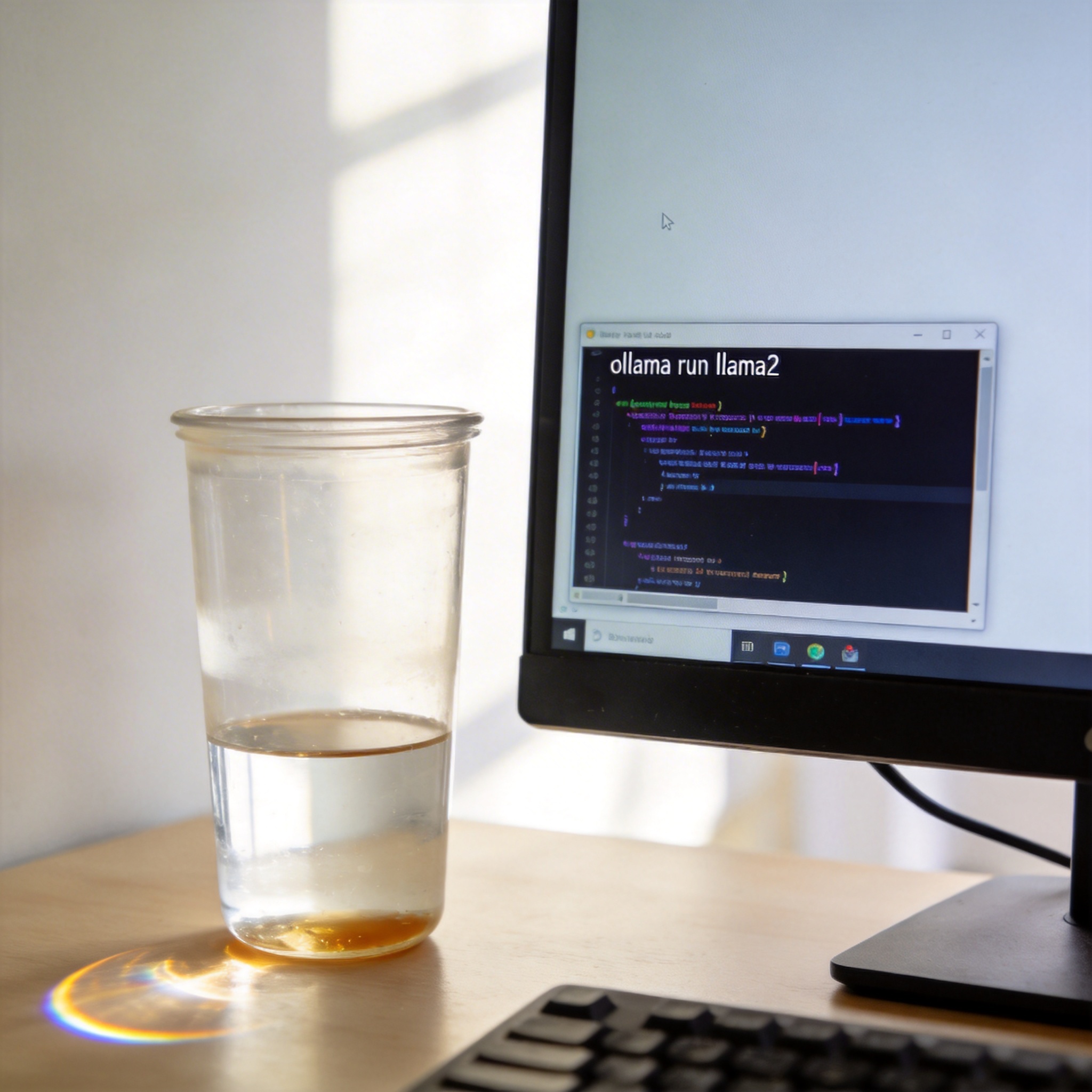

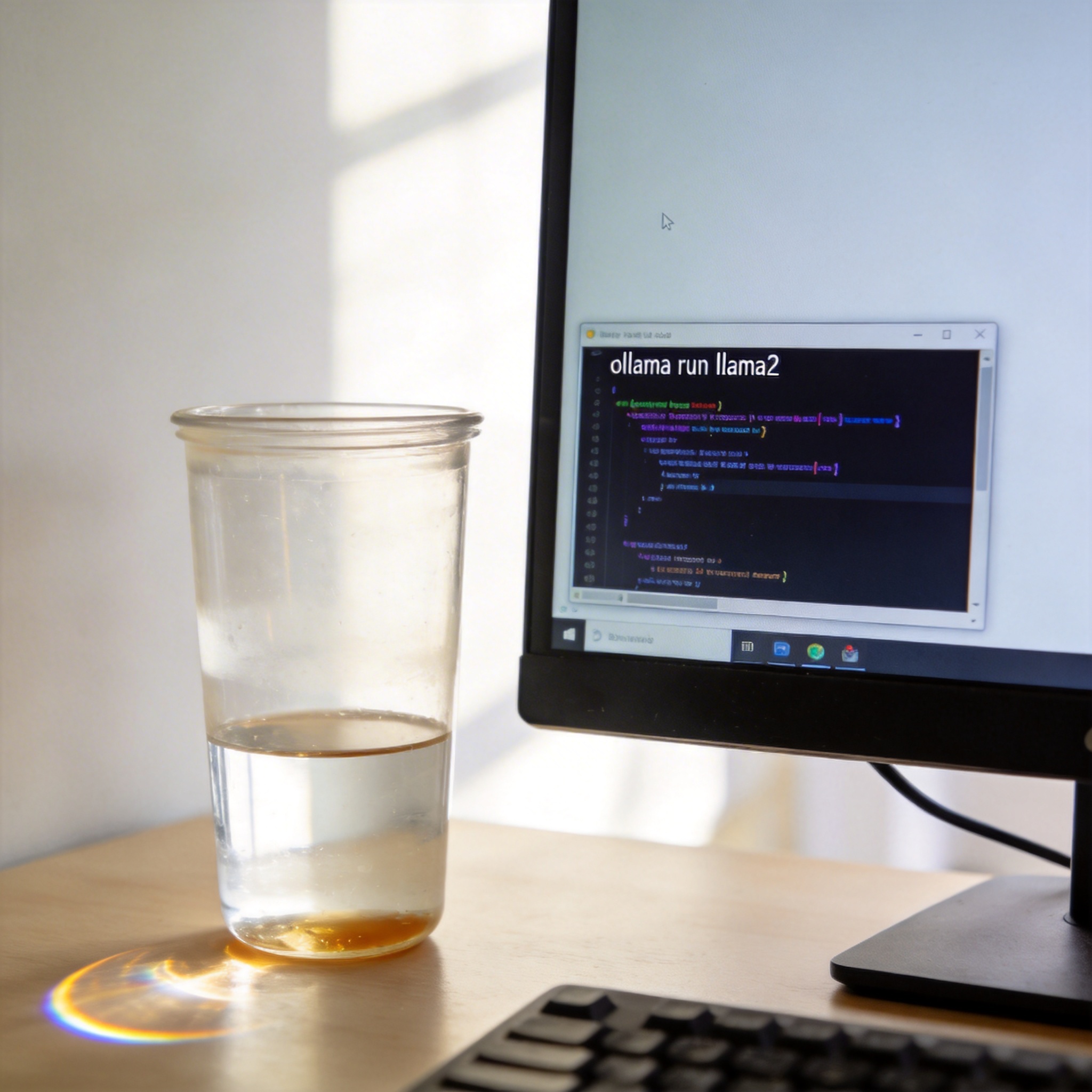

接下来我就把亲测有效的AI 智能对话模型本地部署方法拆解给你。先下载并安装Ollama工具,官网一键安装包几分钟就能搞定,安装完成后打开命令提示符,输入“ollama run llama2”,工具会自动下载7B参数的Llama 2模型,大概10分钟左右就能下完;下载完成后直接在命令行里就能和AI对话,要是想可视化操作,就再安装Text Generation WebUI,把下载好的模型文件夹放到指定目录,启动WebUI后在界面里选择模型就能开始使用。另外我之前还试过在私有服务器上部署,用Ubuntu系统搭配Ollama,只需要开放相应端口,就能在局域网内的电脑、手机上访问,这就是AI 本地化部署私有服务器搭建的核心步骤,整个过程大概30分钟就能完成。

部署过程中我也遇到过不少问题,比如模型下载速度慢,这时候可以换国内的镜像源,我之前把Ollama的镜像源换成国内的,下载速度从每秒100KB涨到了每秒5MB;还有显存不足的问题,要是显卡显存不够,可以用4位量化的模型,比如Llama 27BQ4,显存占用能降到4GB左右;另外要注意关闭后台占用内存的软件,我之前开着多个浏览器标签页部署,结果内存不足导致部署失败,关闭后就顺利完成了。这些细节都是AI 本地部署完整教程与工具里容易被忽略的点,提前了解能少走很多弯路。

接下来我就把亲测有效的AI 智能对话模型本地部署方法拆解给你。先下载并安装Ollama工具,官网一键安装包几分钟就能搞定,安装完成后打开命令提示符,输入“ollama run llama2”,工具会自动下载7B参数的Llama 2模型,大概10分钟左右就能下完;下载完成后直接在命令行里就能和AI对话,要是想可视化操作,就再安装Text Generation WebUI,把下载好的模型文件夹放到指定目录,启动WebUI后在界面里选择模型就能开始使用。另外我之前还试过在私有服务器上部署,用Ubuntu系统搭配Ollama,只需要开放相应端口,就能在局域网内的电脑、手机上访问,这就是AI 本地化部署私有服务器搭建的核心步骤,整个过程大概30分钟就能完成。

部署过程中我也遇到过不少问题,比如模型下载速度慢,这时候可以换国内的镜像源,我之前把Ollama的镜像源换成国内的,下载速度从每秒100KB涨到了每秒5MB;还有显存不足的问题,要是显卡显存不够,可以用4位量化的模型,比如Llama 27BQ4,显存占用能降到4GB左右;另外要注意关闭后台占用内存的软件,我之前开着多个浏览器标签页部署,结果内存不足导致部署失败,关闭后就顺利完成了。这些细节都是AI 本地部署完整教程与工具里容易被忽略的点,提前了解能少走很多弯路。

其实AI 智能对话模型本地部署方法并没有想象中复杂,只要选对工具和模型,跟着步骤一步步来,新手也能在1小时内完成部署。我现在每天都用本地部署的AI写工作周报、梳理项目思路,完全不用依赖网络,数据也都存在自己的设备里,安全感拉满。要是你也有隐私保护或者离线使用的需求,不妨试试这套AI 本地化部署私有服务器搭建的方法,亲测好用还省心。

其实AI 智能对话模型本地部署方法并没有想象中复杂,只要选对工具和模型,跟着步骤一步步来,新手也能在1小时内完成部署。我现在每天都用本地部署的AI写工作周报、梳理项目思路,完全不用依赖网络,数据也都存在自己的设备里,安全感拉满。要是你也有隐私保护或者离线使用的需求,不妨试试这套AI 本地化部署私有服务器搭建的方法,亲测好用还省心。

接下来我就把亲测有效的AI 智能对话模型本地部署方法拆解给你。先下载并安装Ollama工具,官网一键安装包几分钟就能搞定,安装完成后打开命令提示符,输入“ollama run llama2”,工具会自动下载7B参数的Llama 2模型,大概10分钟左右就能下完;下载完成后直接在命令行里就能和AI对话,要是想可视化操作,就再安装Text Generation WebUI,把下载好的模型文件夹放到指定目录,启动WebUI后在界面里选择模型就能开始使用。另外我之前还试过在私有服务器上部署,用Ubuntu系统搭配Ollama,只需要开放相应端口,就能在局域网内的电脑、手机上访问,这就是AI 本地化部署私有服务器搭建的核心步骤,整个过程大概30分钟就能完成。

部署过程中我也遇到过不少问题,比如模型下载速度慢,这时候可以换国内的镜像源,我之前把Ollama的镜像源换成国内的,下载速度从每秒100KB涨到了每秒5MB;还有显存不足的问题,要是显卡显存不够,可以用4位量化的模型,比如Llama 27BQ4,显存占用能降到4GB左右;另外要注意关闭后台占用内存的软件,我之前开着多个浏览器标签页部署,结果内存不足导致部署失败,关闭后就顺利完成了。这些细节都是AI 本地部署完整教程与工具里容易被忽略的点,提前了解能少走很多弯路。

接下来我就把亲测有效的AI 智能对话模型本地部署方法拆解给你。先下载并安装Ollama工具,官网一键安装包几分钟就能搞定,安装完成后打开命令提示符,输入“ollama run llama2”,工具会自动下载7B参数的Llama 2模型,大概10分钟左右就能下完;下载完成后直接在命令行里就能和AI对话,要是想可视化操作,就再安装Text Generation WebUI,把下载好的模型文件夹放到指定目录,启动WebUI后在界面里选择模型就能开始使用。另外我之前还试过在私有服务器上部署,用Ubuntu系统搭配Ollama,只需要开放相应端口,就能在局域网内的电脑、手机上访问,这就是AI 本地化部署私有服务器搭建的核心步骤,整个过程大概30分钟就能完成。

部署过程中我也遇到过不少问题,比如模型下载速度慢,这时候可以换国内的镜像源,我之前把Ollama的镜像源换成国内的,下载速度从每秒100KB涨到了每秒5MB;还有显存不足的问题,要是显卡显存不够,可以用4位量化的模型,比如Llama 27BQ4,显存占用能降到4GB左右;另外要注意关闭后台占用内存的软件,我之前开着多个浏览器标签页部署,结果内存不足导致部署失败,关闭后就顺利完成了。这些细节都是AI 本地部署完整教程与工具里容易被忽略的点,提前了解能少走很多弯路。

其实AI 智能对话模型本地部署方法并没有想象中复杂,只要选对工具和模型,跟着步骤一步步来,新手也能在1小时内完成部署。我现在每天都用本地部署的AI写工作周报、梳理项目思路,完全不用依赖网络,数据也都存在自己的设备里,安全感拉满。要是你也有隐私保护或者离线使用的需求,不妨试试这套AI 本地化部署私有服务器搭建的方法,亲测好用还省心。

其实AI 智能对话模型本地部署方法并没有想象中复杂,只要选对工具和模型,跟着步骤一步步来,新手也能在1小时内完成部署。我现在每天都用本地部署的AI写工作周报、梳理项目思路,完全不用依赖网络,数据也都存在自己的设备里,安全感拉满。要是你也有隐私保护或者离线使用的需求,不妨试试这套AI 本地化部署私有服务器搭建的方法,亲测好用还省心。

相关文章推荐: